A inteligência artificial generativa não se resume a chamar a API da OpenAI.

O RAG (Retrieval-Augmented Generation) permite que integremos os nossos próprios dados ao contexto da LLM de forma dinâmica.

Em vez de treinar modelos caros, utilizamos bancos vetoriais como Pinecone ou Milvus para buscar informações relevantes.

O PHP é perfeitamente capaz de orquestrar este fluxo usando bibliotecas modernas de clientes HTTP.

O segredo está em transformar o conteúdo dos posts do WordPress em embeddings vetoriais.

Isso permite criar chatbots que realmente conhecem o conteúdo do seu blog.

// Exemplo de integração conceitual

$vector = $aiProvider->generateEmbedding($postContent);

$relevantDocs = $vectorDatabase->search($vector);

$response = $llm->ask("Responda com base nisto: " . $relevantDocs);Explicando o “porquê”: sem RAG, as LLMs alucinam sobre fatos que elas não conhecem.

Com RAG, fornecemos a “cola” (o contexto) antes da pergunta ser feita ao modelo.

Isso economiza tokens e aumenta a precisão das respostas.

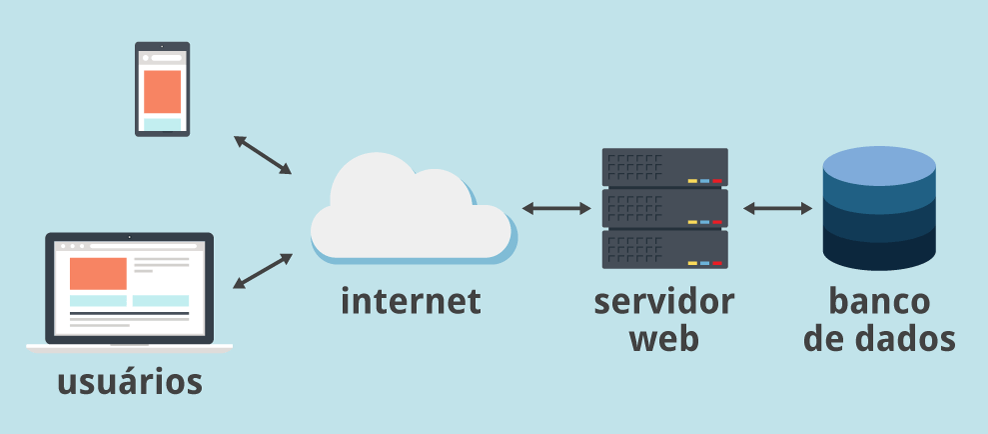

Como especialistas em WordPress, podemos automatizar este processo sempre que um post é salvo no banco de dados.

A IA deve trabalhar para nós, estruturando o conhecimento massivo que geramos diariamente.

Prepare o seu ambiente PHP para lidar com grandes volumes de dados multidimensionais.